En els darrers anys, la intel·ligència artificial ha irromput en el nostre dia de forma vertiginosa i des de fa escassament tretze mesos l’aparició del chatGPT i les glorioses gestes de la IA generativa ens tenen fascinats a uns i espantats a uns altres. No es fa altra cosa que parlar dels riscos i virtuts d’aquesta disciplina que, pel que sembla, ha arribat per quedar-se i per canviar-nos definitivament no només la vida, sinó també la societat.

En realitat la IA no és una cosa nova. Fa molts anys que camina, des del 1956 per ser preciosos, quan John McCarthy va celebrar l’escola d’estiu de Darmouth i els savis allí convocats van concloure que era viable construir màquines que poguessin imitar el comportament intel·ligent dels humans.

Hem corregut molt des de llavors i des de les primeres aplicacions, que miraven de moure blocs en escenaris de joguina d’unes posicions a unes altres o de jugar a escacs. Hem evolucionat amb les noves tecnologies com els sensors, el 5G, la computació d’altres prestacions cap a capacitats mai abans imaginades, com poder reconèixer una persona per la veu o per la cara, etiquetar imatges en pocs segons, trobar tumors en tomografies o pronosticar si comprarem o no un nou cotxe en els propers tres mesos.

El sector productiu està en plena ebullició mirant d’incorporar la intel·ligència artificial al seu negoci, sigui personalitzant millor el client, optimitzant els processos o dissenyant estratègies. I el públic en general assisteix atònit a una de les revolucions més significatives que veu la humanitat en aquests darrers segles.

Els primers passos per a una ètica

El cas és que, amb una tecnologia tan potent que pot resoldre problemes tan complexos, els possibles usos, les potencialitats i les oportunitats per crear un món millor són tantes com els riscos de fer-ho de formes no tan democràtiques ni equitatives. I aquí és quan la Comissió Europea ja fa uns anys va emprendre el lideratge de marcar un desenvolupament ètic per a la intel·ligència artificial que posi sobretot les persones al centre i vetlli per un respecte escrupolós pels drets humans.

I aquest camí recorre Europa des que el 2018 es va constituir l’Aliança Europea per a la Intel·ligència Artificial i el High Level Expert Group on AI (un grup d’experts d’alt nivell), que ha assessorat la Comissió Europea en el desenvolupament d’aquest marc que orienti el sector cap a una concepció ètica. De fet, el primer treball del High Level Expert Group va ser el document de recomanacions ètiques per a una intel·ligència artificial segura i confiable, que va veure la llum l’abril del 2019.

Més tard es va fer un llibre blanc sobre la IA que va obrir consulta pública el febrer del 2020 i un any més tard es confeccionà el projecte de llei de la intel·ligència artificial (la AI Act) que porta des d’abril del 2021 en un procés lent de consultes públiques, al·legacions i aprovacions per diferents organismes fins que, la matinada del 10 de desembre, després de moltes hores de negociacions, la tríada formada per la Comissió Europea, el Parlament Europeu i el Consell Europeu va aprovar el Reglament Europeu de la IA, que ara s’enviarà al Parlament per a la darrera fase de votacions, amb l’expectativa que pugui entrar en vigor el 2026.

Fem tard?

Però de fet, amb regulació o sense, ens trobem davant d’una tecnologia que evoluciona a velocitats de vertigen i, entre que es va gestar el primer document de proposta de llei fins que el que s’acaba d’aprovar, han aparegut eines noves i tan disruptives com el chatGPT, que va obligar a afegir una clàusula nova sobre els Grans Models de Llenguatge (els Large Language Models), que ni tan sols existien quan aquest text es va començar a definir.

La doble velocitat entre la lentitud de les lleis que es fan i la supersònica velocitat de la innovació tecnològica planteja un dilema on sempre la llei anirà per darrere de la tecnologia i és gairebé segur que les regulacions presents i futures gairebé sempre faran tard. En realitat, els tempos dels processos legislatius no són fàcils. Hi ha tot un sistema de garanties que cal respectar. Els temps de consulta pública, d’esmenes, de negociacions, per garantir que no es deixa res important per considerar, que no es vulnera cap col·lectiu, que no s’infringeixen drets de persones de cap mena requereix una calma que contraposa fortament amb el que passa en el món tecnològic.

En el cas de la IA, ja tenim un pas guanyat, perquè molt encertadament s’ha decidit que no farem una llei, sinó una regulació, que com a tal serà d’aplicació immediata i no requerirà transposició en els diferents països, la qual cosa encara dilataria més l’entrada en vigor. Però, tot i això, els tempos són molt més llargs que el que vibra en el desenvolupament de la tecnologia.

En el cas de la IA molt encertadament a nivell d’UE s’ha decidit no fer una llei, sinó una regulació, que com a tal serà d’aplicació immediata i no requerirà transposició en els diferents països

La importància de l’ètica i la deontologia

I és, doncs, per això que cada cop més aspectes com l’ètica i la deontologia esdevenen més i més necessaris en un context on, inexorablement, les lleis arribaran tard i, quan arribin, serviran segurament per sancionar els mals usos, però no per prevenir-los i evitar-los. En aquest sentit necessitem una conjura global on tots els actors involucrats en l’àmbit de la IA, des dels governants als fabricants, passant pels proveïdors de tecnologia, els consultors, els usuaris i la societat civil, ens comprometem, cadascun en el que li pertoca, a sumar per un desenvolupament i adopció d’una IA ètica i potenciadora d’un món millor, i no sumar per un desenvolupament que pugui incrementar les desigualtats socials.

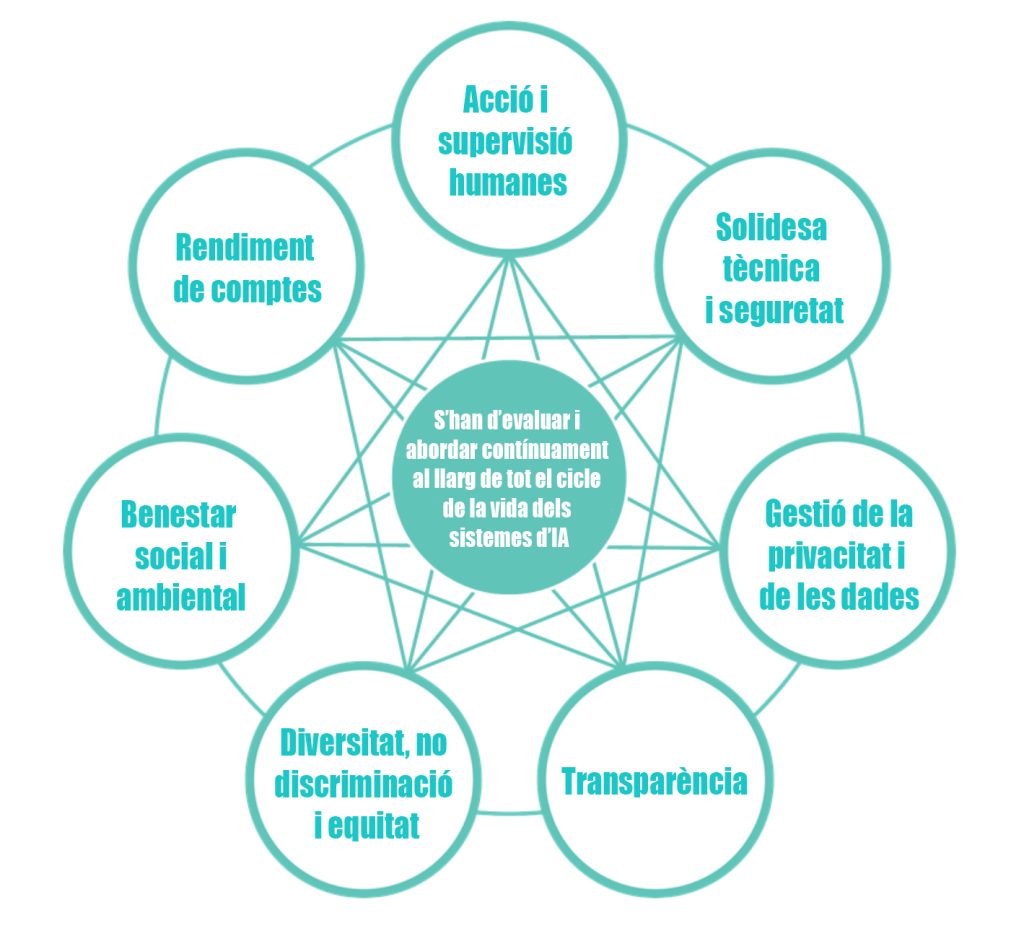

Les recomanacions ètiques que publica la Comissió Europea el 2018 defineixen un marc basat en set eixos que haurien de governar el desenvolupament de les aplicacions en intel·ligència artificial.

· Que la IA no sigui autònoma sinó que sigui supervisada per un especialista o professional que en validi els resultats abans de decidir si s’apliquen o no.

· Que sigui robusta i segura.

· Que respecti la privacitat i no faci ús il·lícit de dades personals o sensibles.

· Que sigui transparent, no només en el sentit de saber quan hi ha una IA que actua sinó també en el de poder entendre amb quins criteris es regeix quan recomana o fa prediccions.

· Que garanteixi uns resultats equitatius i que no tingui biaixos que puguin vulnerar grups de persones (dones, pobres, ancians, etc.).

· Que sigui una IA per al benestar i que sigui sostenible.

· I que practiqui el retiment de comptes.

No serà senzill operativitzar tots aquests principis, però sí que defineixen un marc de desenvolupament i implantació de la IA que minimitza els riscos per a les persones. Caldrà també trobar l’equilibri entre la regulació i la innovació i com implementar els diferents controls que requereix el compliment de la llei.

Ara bé, cal remarcar que l’ètica no és llei! Que, si bé és cert que una part de la nova llei recull algunes de les recomanacions que es fan el 2018, vigilar el compliment d’una llei no necessàriament vol dir fer-ne una aplicació ètica; perquè l’ètica, al final, fa part d’allò que voluntàriament les comunitats pacten en pro d’una convivència millor i s’han d’assumir més a títol personal que sistèmic. Per això, en aquest moment, les qüestions deontològiques i d’ètica personal estan agafant una preponderància que van més enllà de la regulació.

Karina Gibert és catedràtica i directora del centre de recerca Intelligent Data Science and Artificial Intelligence (IDEAI-UPC) i ha participat en la redacció del Pla Estratègic per a la IA del govern català i assessorat la Comissió Europea en qüestions d’ètica i IA